Im maschinellen Lernen haben es nur wenige Ideen geschafft, Komplexität so zu vereinen, wie die Periodenzüchter einmal für die Chemie durchgeführt wurden. Jetzt, Forscher von MIT, Microsoft und Google Versuchen Sie, genau das mit I-Con oder Informationskontrastivlernen zu tun. Die Idee ist täuschend einfach: Die meisten Algorithmen für maschinelles Lernen darstellen – Klassifizierung, Regression, Clusterbildung und sogar große Sprachmodelle – als besondere Fälle eines allgemeinen Prinzips: Erlernen der Beziehungen zwischen Datenpunkten.

Genau wie chemische Elemente in vorhersehbare Gruppen fallen, behaupten die Forscher, dass auch Algorithmen für maschinelles Lernen ein Muster bilden. Durch die Zuordnung dieser Muster klärt I-Con nicht nur alte Methoden. Es prognostiziert neue. Eine solche Vorhersage? Ein hochmoderner Bildklassifizierungsalgorithmus, der keine menschlichen Etiketten erfordert.

Stellen Sie sich ein Abendessen in Ballsaal vor. Jeder Gast (Datenpunkt) findet einen Sitz (Cluster) idealerweise in der Nähe von Freunden (ähnliche Daten). Einige Freunde sitzen zusammen, andere verbreiten sich über Tische. Diese Metapher, die als Clustering-Gala bezeichnet wird, erfasst, wie I-Con Clustering behandelt: Optimieren Sie, wie genau die Datenpunktgruppen basierend auf inhärenten Beziehungen basieren. Es geht nicht nur darum, wer neben wem steht, sondern welche Arten von Bindungen wichtig sind. Sei es visuelle Ähnlichkeit, freigegebene Klassenbezeichnungen oder Grafikverbindungen.

Diese Ballroom -Analogie erstreckt sich auf das gesamte maschinelle Lernen. Das I-Con-Framework zeigt, dass Algorithmen hauptsächlich in der Definition dieser Beziehungen unterscheiden. Ändern Sie die Gästeliste oder die Sitzlogik, und Sie erhalten Dimensionalitätsreduzierung, selbstversorgunges Lernen oder spektrales Clustering. Alles läuft darauf hinaus, bestimmte Beziehungen zu bewahren und andere zu vereinfachen.

Die Architektur hinter i-con

Im Kern basiert die I-Con auf einer Informationstheoretik. Das Ziel: Minimieren Sie die Differenz (KL -Divergenz) zwischen einer Zielverteilung, dem Algorithmus und einer gelernten Verteilung der tatsächlichen Modellausgabe. Formal ist dies als:

L (θ, ϕ) = ∑ dKL(pθ (· | i) || qϕ (· | i))

Es ergeben sich unterschiedliche Lerntechniken aus der Art und Weise, wie die beiden Verteilungen pθ und qϕ konstruiert sind. Wenn pθ Bilder nach visueller Nähe und qϕ gruppiert sie durch Ähnlichkeit mit Kennzeichnung, wird das Ergebnis überwacht. Wenn sich pθ auf die Graphenstruktur beruht und Qϕ sie durch Cluster nähert, erhalten wir spektrale Clusterbildung. Sogar die Sprachmodellierung passt in die Behandlung von Token-Ko-Auftreten als eine Beziehung, die aufbewahrt werden soll.

Der Tisch, der alles organisiert

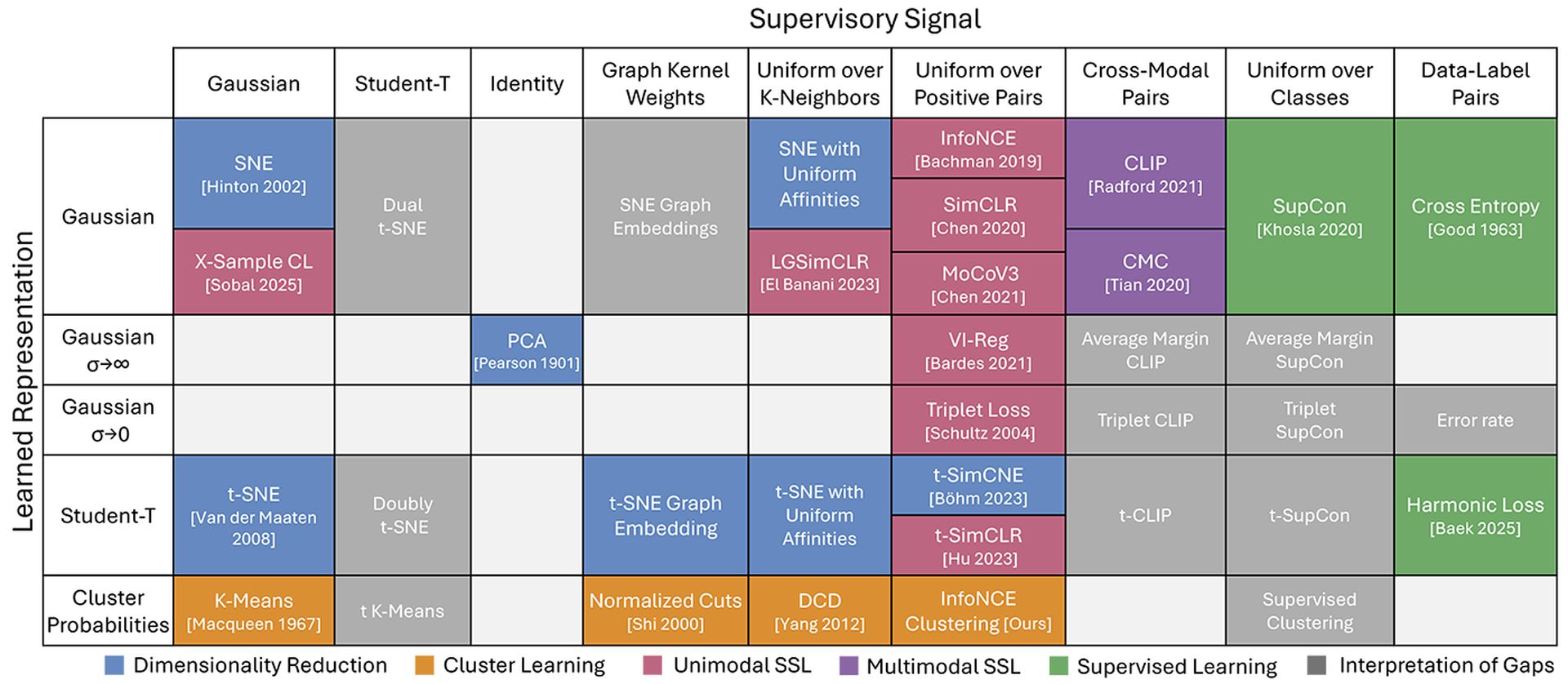

Inspiriert von der Periodenzüchttabelle der Chemie baute das I-CON-Team eine Grid-Kategorisierungsalgorithmen auf der Grundlage ihrer Verbindungstypen auf. Jedes Quadrat in der Tabelle stellt eine eindeutige Art und Weise dar, wie sich Datenpunkte im Eingangs- und Ausgangsraum beziehen. Sobald alle bekannten Techniken platziert wurden, blieben überraschende Lücken. Diese Lücken zeigten nicht auf fehlende Daten – sie deuteten auf Methoden hin, die existieren konnten, aber noch nicht entdeckt worden waren.

Um dies zu testen, füllten die Forscher eine solche Lücke aus, indem sie das Clustering mit debias kontrastivem Lernen kombinieren. Das Ergebnis: Eine neue Methode, die vorhandene unbeaufsichtigte Bildklassifizierer auf ImageNet um 8%übertroffen hat. Es funktionierte durch die Injektion einer geringen Menge an Lärm – „universelle Freundschaft“ unter Datenpunkten -, die den Clustering -Prozess stabiler und weniger vorvertreter auf Zuordnungen machte.

Debiasing spielt eine zentrale Rolle bei dieser Entdeckung. Traditionelles kontrastives Lernen bestraft unterschiedliche Beispiele zu hart, selbst wenn diese Stichproben möglicherweise nicht wirklich nicht miteinander verbunden sind. I-Con führt einen besseren Ansatz ein: Mischen in einer einheitlichen Verteilung, die übermäßig strenge Annahmen über Datenabtrennungen mischt. Es ist eine konzeptionell saubere Optimierung mit messbaren Leistungssteigerungen.

Eine andere Methode besteht darin, die Definition der Nachbarschaft selbst zu erweitern. Anstatt sich nur auf direkte Nachbarn zu betrachten, propagiert I-Con durch das Nachbarschaftsgraphen-und „Spaziergänge“, um mehr globale Struktur zu erfassen. Diese Spaziergänge simulieren, wie sich Informationen über Knoten auf Knoten ausbreiten und den Clustering -Prozess verbessern. Tests an Dino-Vision-Transformers bestätigen, dass die kleine Ausbreitung (Gehenlänge von 1 oder 2) den größten Gewinn ergibt, ohne das Modell zu überwältigen.

Nachforschungen: Google’s KI frisst Ihre Klicks

Leistung und Auszahlung

Das I-Con-Framework ist nicht nur die Theorie. Auf ImageNet-1K übertraf es frühere hochmoderne Clustering-Modelle wie TEMI und Scan mit einfacheren, selbstausgleichenden Verlustfunktionen. Im Gegensatz zu seinen Vorgängern benötigt I-Con keine manuell abgestimmten Strafen oder Größenbeschränkungen. Es funktioniert nur-Across Dino Vit-S, Vit-B und Vit-L-Rückgrat.

Debiased Infonce Clustering (I-Con) Verbesserte ungarische Genauigkeit von:

- +4,5% auf Vit-B/14

- +7,8% auf Vit-L/14

Es übertraf auch K-Means, kontrastives Clustering und konsequent. Der Schlüssel liegt in der sauberen Vereinigung von Methoden und Anpassungsfähigkeit – Clusterwahrscheinlichkeiten, Nachbargraphen, Klassenbezeichnungen, alle unter einen Regenschirm.

I-Con ist nicht nur ein Unifier; Es ist eine Blaupause für die Erfindung. Indem sie zeigen, dass viele Algorithmen nur unterschiedliche Möglichkeiten für die Auswahl von Nachbarschaftsverteilungen sind, ermöglichen es Forschern, neue Kombinationen zu erfinden. Tauschen Sie einen Verbindungstyp gegen einen anderen aus. Debiasing mischen. Tune nach der Nachbarschaftstiefe. Jede Option entspricht einem neuen Eintrag in der Tabelle – einem neuen Algorithmus, der zum Testen bereit ist.

Wie sich ShaTen Alshammari von MIT ausdrückte, fühlt sich das maschinelle Lernen weniger wie eine Kunst des Vermutungen und eher wie ein strukturierter Designraum an. I-Con verwandelt das Lernen in Erkundungen-ohne Alchemie, mehr Ingenieurwesen.

Was I-Con wirklich anbietet, ist eine tiefere Philosophie des maschinellen Lernens. Es zeigt sich, dass unter der enormen Vielfalt von Modellen und Methoden eine gemeinsame Struktur vorhanden sein kann – eine, die nicht auf starren Formeln, sondern auf relationaler Logik aufgebaut ist. In diesem Sinne löst I-Con keine Intelligenz. Es kartiert es. Und wie der erste periodische Tisch gibt es uns einen Einblick in das, was noch darauf wartet, entdeckt zu werden.