Google DeepMind enthüllt Gemini 2.5 am 25. März 2025 und nannte es ihr bisher intelligentestes KI -Modell. Diese experimentelle Version, Gemini 2.5 Pro, beansprucht den Spitzenplatz in der Larena -Rangliste und verbesserte die Fähigkeiten der Argumentation und Codierung.

Was bietet es?

Gemini 2.5 -Modelle sind als „Denkmodelle“ ausgelegt. Sie können durch ihre Gedanken vor der Reaktion argumentieren, was sowohl die Leistung als auch die Genauigkeit stärkt. Dies beinhaltet die Analyse von Informationen, die Abgabe logischer Abzüge, das Verständnis des Kontextes und die Treffen von fundierten Entscheidungen.

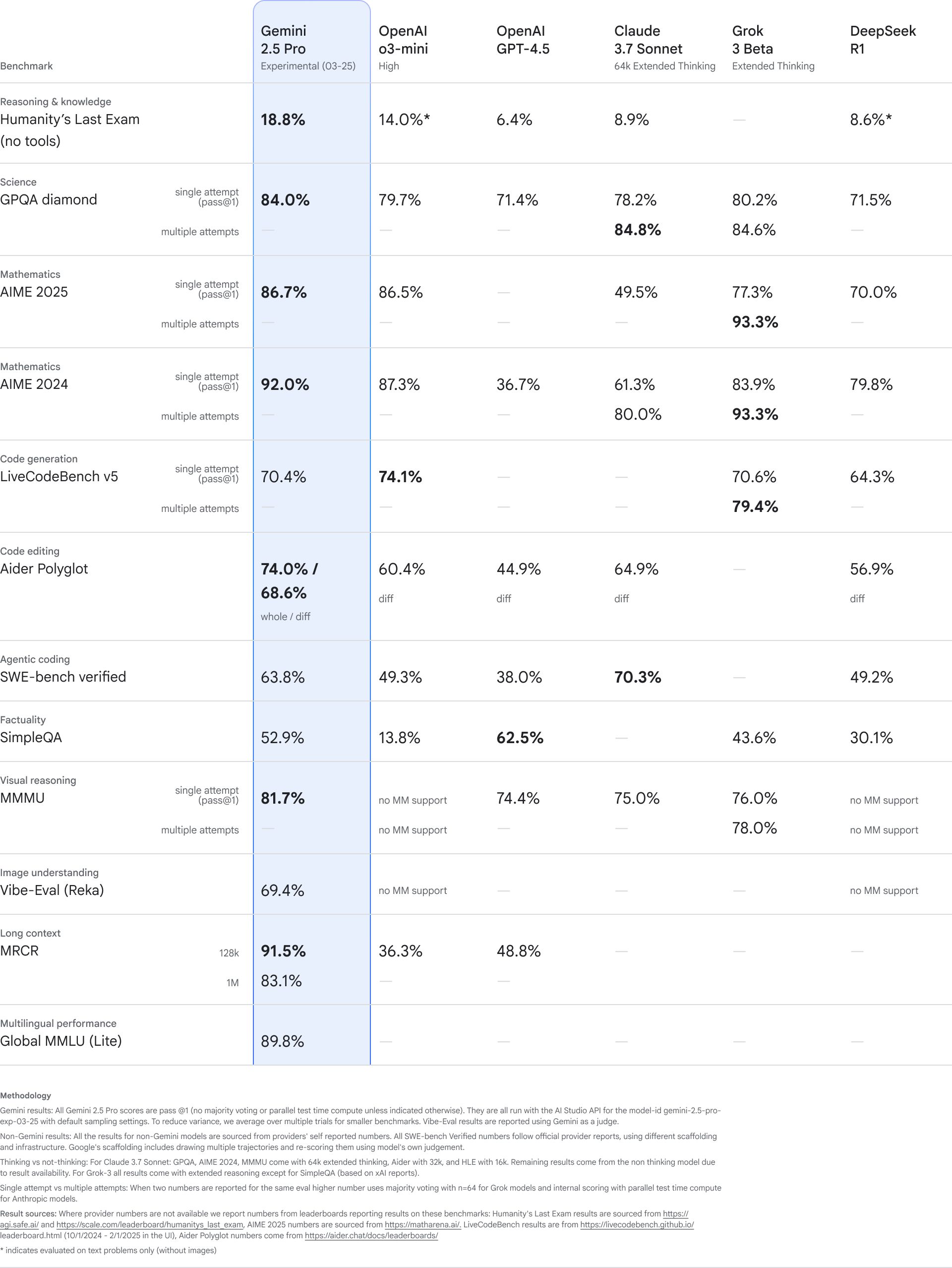

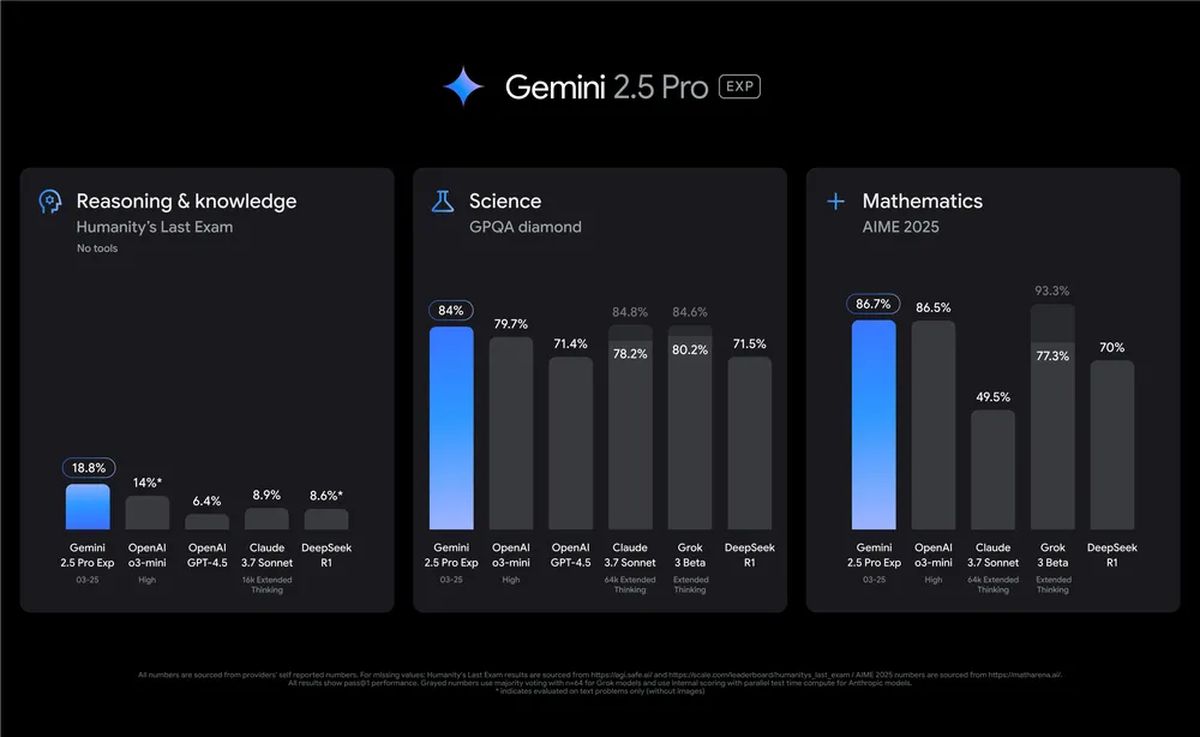

Gemini 2.5 Pro Experimental wird für komplexe Aufgaben gebaut. Das Modell führt in allgemeinen Kodierung, Mathematik und wissenschaftlichen Benchmarks.

Gemini 2.5 Pro ist derzeit in Google AI Studio und in der Gemini -App für Gemini Advanced Users verfügbar. In den kommenden Wochen wird in den kommenden Wochen mit Preisgestaltung und höheren Ratengrenzen für die Produktionsnutzung ebenfalls auf dem Weg zur Vertex -KI stattfinden.

Das Modell erzielte eine hochmoderne Punktzahl von 18,8% bei der letzten Prüfung der Menschheit, einem Datensatz, der von Hunderten von Experten zur Messung des menschlichen Wissens und der Argumentation hergestellt wurde, und leitet den Bereich in Mathematik- und Wissenschaftbenchmarks wie GPQA und Aime 2025.

Gemini 2.5 Pro hat Fortschritte bei der Codierungsleistung gemacht. Das Modell erhielt 63,8% bei SWE-Bench mit einem benutzerdefinierten Agenten-Setup in Agentencode-Bewertungen.

Gemini 2.5 Pro behält die Kernstärken von bei Gemini -Modelleeinschließlich native Multimodalität und ein langes Kontextfenster. Es wird mit einem 1-Millionen-geschwenkten Kontextfenster geliefert, wobei eine 2-Millionen-Version bald kommt. Dies ermöglicht es ihm, große Datensätze zu verarbeiten und Probleme mit Text, Audio, Bildern, Videos und sogar gesamten Code -Repositories anzugehen.

Entwickler und Unternehmen können sofort mit Gemini 2.5 Pro in Google AI Studio experimentieren. Gemini Advanced Benutzer können es im Modell der Modell auswählen, und der Vertex -AI -Zugriff wird in den kommenden Wochen folgen.