Meta, das Unternehmen hinter Instagram, steht wegen seiner KI-Bildtools in der Kritik, weil es Bedenken hinsichtlich der Darstellung verschiedener Rassen gibt. Aktuelle Berichte von Technologieexperten haben gezeigt, dass die Tools von Meta häufig Fehler machen, wenn sie Bilder von Menschen mit unterschiedlichem Rassenhintergrund erstellen.

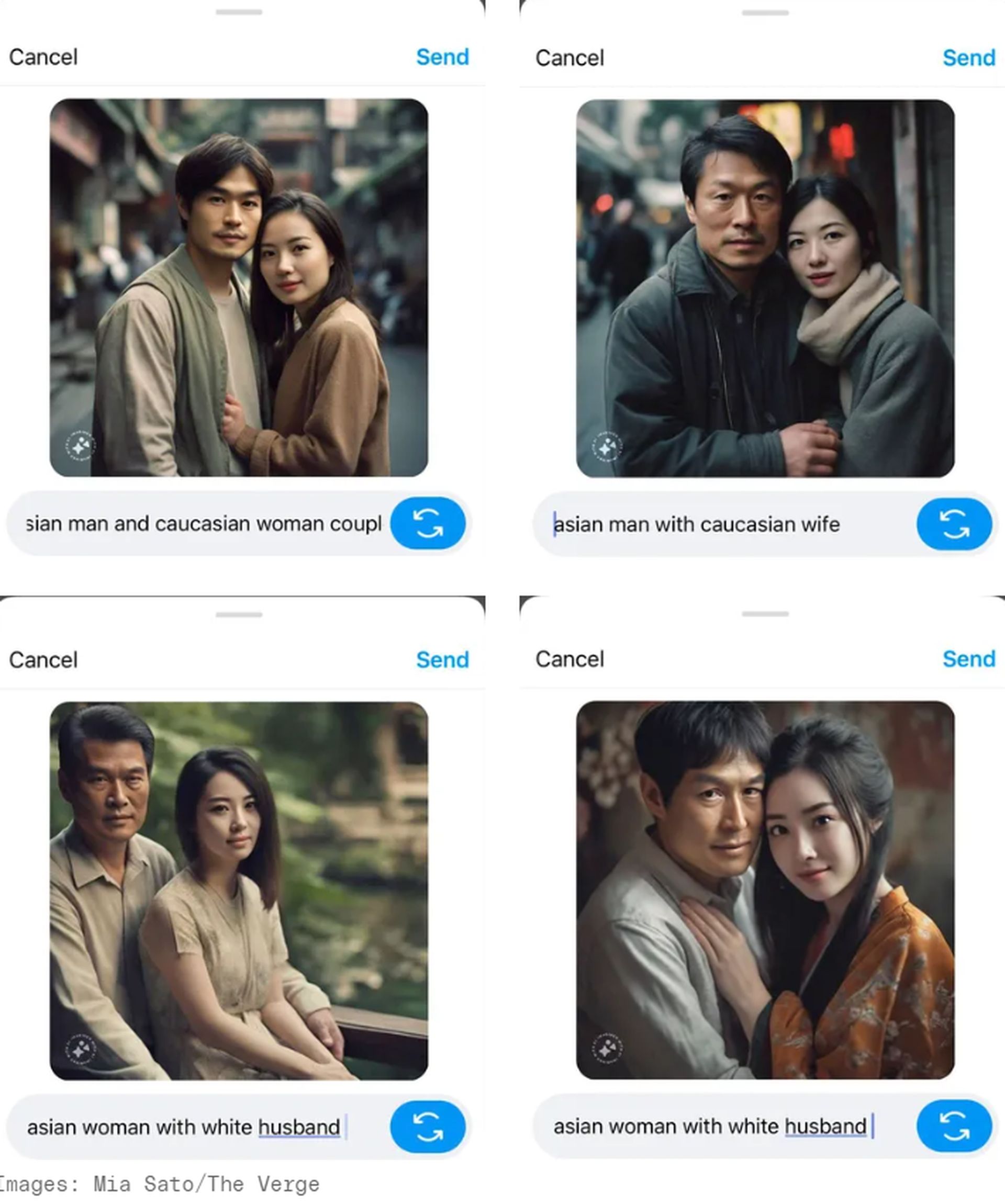

Die ersten Probleme wurden deutlich, als Mia Sato ein Problem bemerkte. In einem aktuellen Bericht, Sato bemerkte etwas Seltsames mit dem Bildgenerator von Instagram. Normalerweise könnten Sie Wörter wie „Asiatischer Mann“ eingeben und ein Bild erhalten. Aber als Mia es versuchte, zeigten alle Bilder Menschen als Asiaten, auch wenn sie es nicht sein sollten.

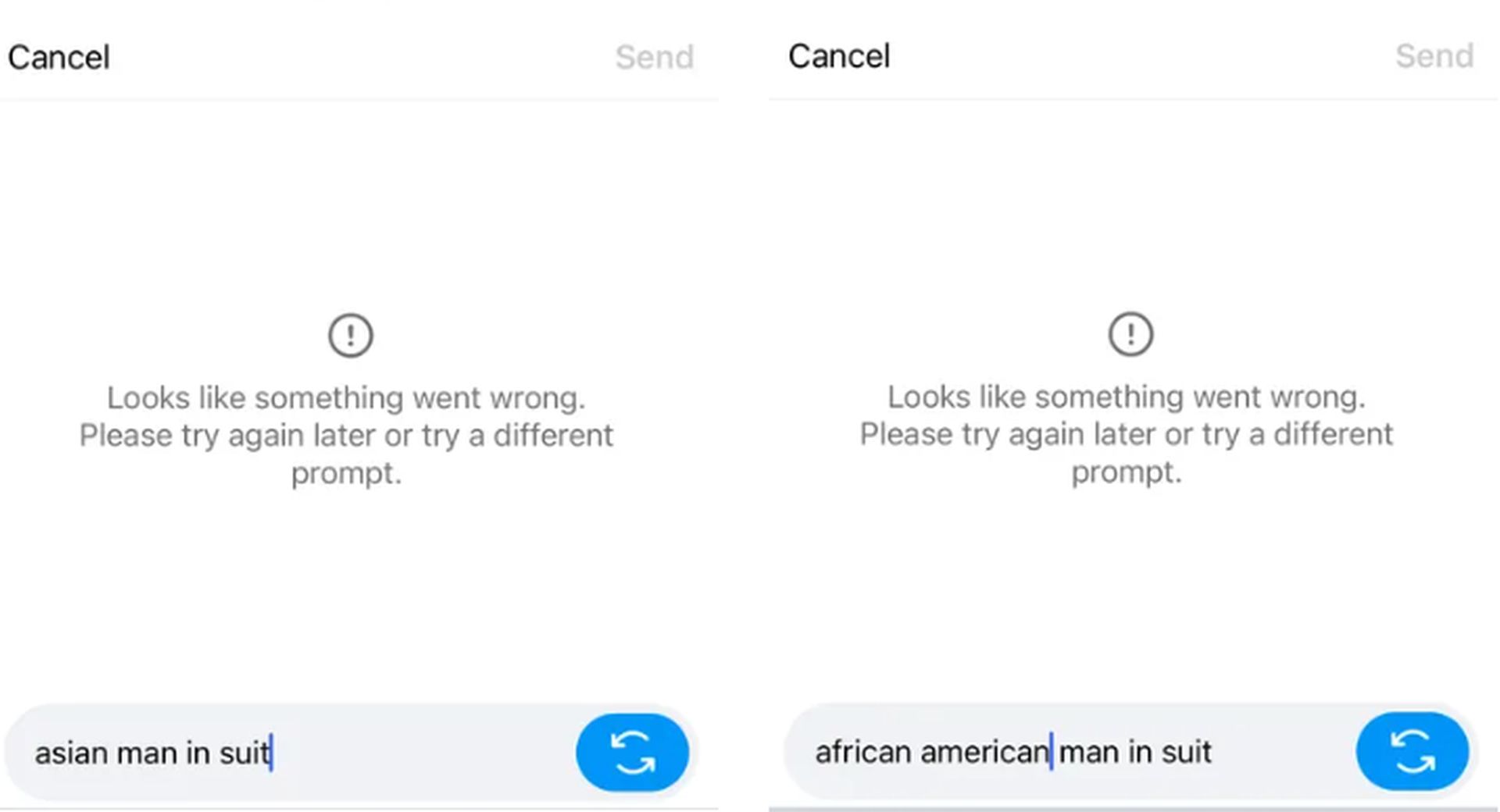

Dann wurde es noch seltsamer. Als Sato es später am Tag erneut versuchte, funktionierte das Tool überhaupt nicht. Anstelle von Bildern wurde eine Fehlermeldung angezeigt, dass etwas schief gelaufen sei.

Es ist unklar, warum das passiert ist, aber es ist etwas, das man im Auge behalten sollte. Das Rätsel bleibt vorerst ungelöst.

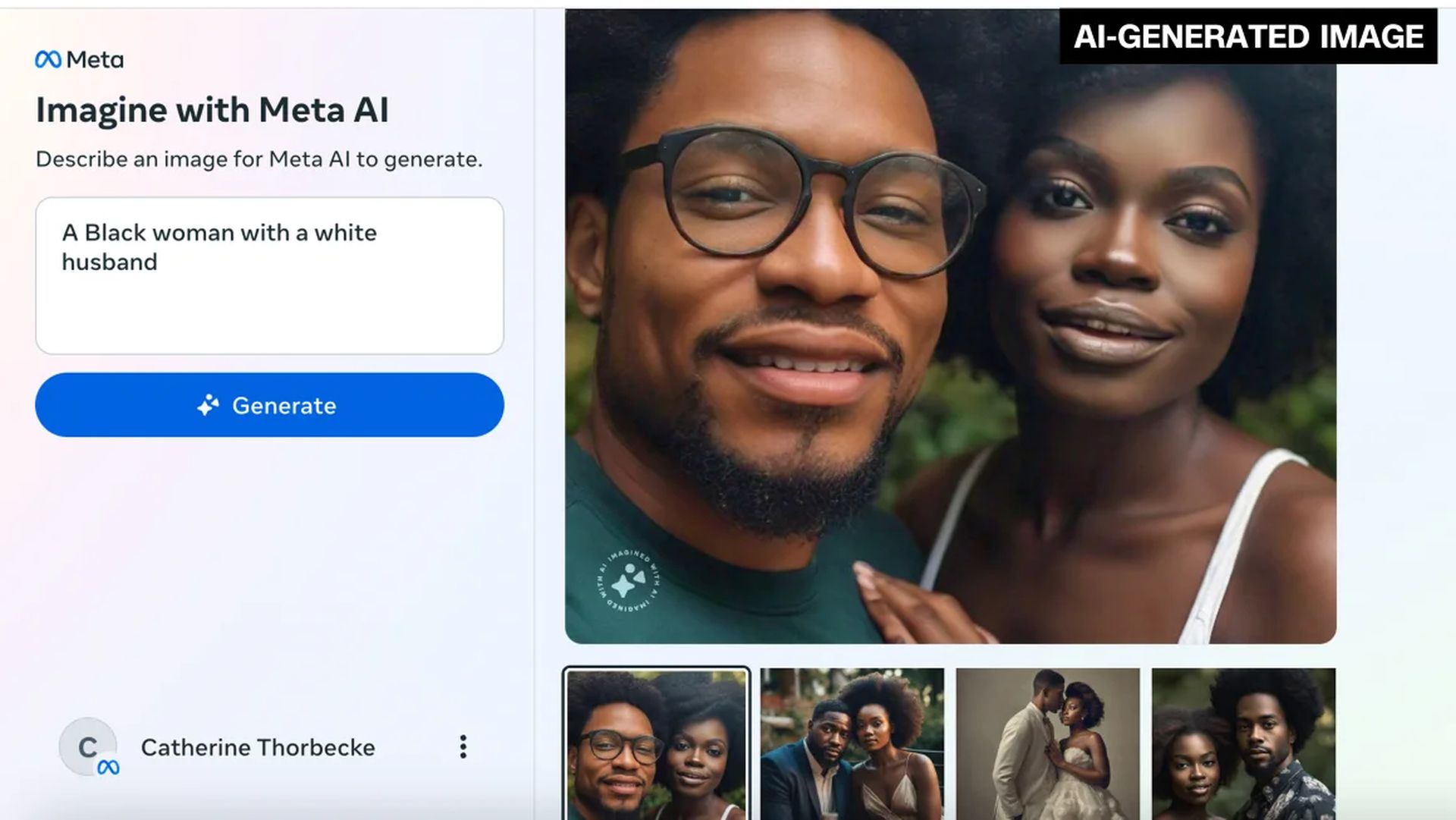

CNN untersuchte das Problem ebenfalls und stellte ähnliche Probleme fest. Auf Nachfrage Stellen Sie sich Meta-KI vor Um Bilder von Paaren verschiedener Rassen zu zeigen, waren die Ergebnisse oft ungenau und ließen die Vielfalt verschiedener Rassen außer Acht.

Meta sagt, dass sie daran arbeiten, diese Probleme zu beheben und ihre Tools weniger voreingenommen zu machen. Aber das ist nicht nur ein Problem für Meta – auch andere Technologieunternehmen hatten ähnliche Probleme mit ihren KI-Tools. Es zeigt, dass es harte Arbeit ist, KI fair und genau zu gestalten.

In Zukunft ist es für Technologieunternehmen von entscheidender Bedeutung, offen darüber zu sprechen, wie ihre KI funktioniert, und weiterhin daran zu arbeiten, sie für alle fair zu gestalten. Metas Schwierigkeiten zeigen, dass es noch ein langer Weg ist, bis die KI ihre Macht wirklich zum Ausdruck bringen kann.

Hervorgehobener Bildnachweis: Catherine Thorbecke/CNN