Elon Musks Projekt für künstliche Intelligenz, xAIerregt Aufmerksamkeit mit der Veröffentlichung einer aktualisierten Version seines Grok-Sprachmodells. Genannt Grok-1.5Diese neueste Version verfügt über ein wesentlich verbessertes Kurzzeitgedächtnis und verbesserte Denkfähigkeiten.

Die Kraft des Gedächtnisses von Grok-1.5

Ein zentraler Aspekt des Upgrades von Grok-1.5 ist eine deutliche Steigerung der Kurzzeitgedächtniskapazität. In großen Sprachmodellen (LLMs) wird dieser Speicher in „Token„.

Grob gesagt können Token als grundlegende Bedeutungseinheiten innerhalb eines Textes betrachtet werden, unabhängig davon, ob es sich um Wörter oder Wortteile handelt. Grok-1.5 kann jetzt bis zu 128.000 Token verarbeitenA 16-fache Steigerung gegenüber dem Vorgänger.

Warum ist diese erweiterte Speicherkapazität wichtig??

Es ermöglicht Grok-1.5, bei der Ausführung seiner Aufgaben wesentlich größere Informationsblöcke zu speichern und zu verarbeiten. Stellen Sie sich vor, Sie versuchen, einen komplexen Rechtsvertrag zu verstehen, obwohl Sie jeweils nur einen einzelnen Absatz lesen dürfen.

Eine KI mit Ein starkes Kurzzeitgedächtnis kann das Gesamtbild „sehen“.Dadurch kann es bessere Entscheidungen treffen und aufschlussreichere Antworten generieren.

Das Denken macht einen Sprung

Neben einem verbesserten Gedächtnis weist Grok-1.5 verbesserte Denkfähigkeiten auf. Dies führt zu der Fähigkeit, die komplexen Zusammenhänge zwischen Informationen besser zu verstehen und logische Schlussfolgerungen zu ziehen.

Für Benutzer bedeutet dies, dass Grok-1.5 möglicherweise besser in der Lage ist:

- Die Nuancen und Komplexitäten eines langen Textes verstehen

- Einer Kette von Anweisungen oder Aufforderungen folgen, auch wenn diese nicht vollkommen linear sind

- Bereitstellung von Zusammenfassungen, die die wichtigsten Punkte eines Dokuments genau wiedergeben

Codierung und Berechnungen bekommen einen Schub

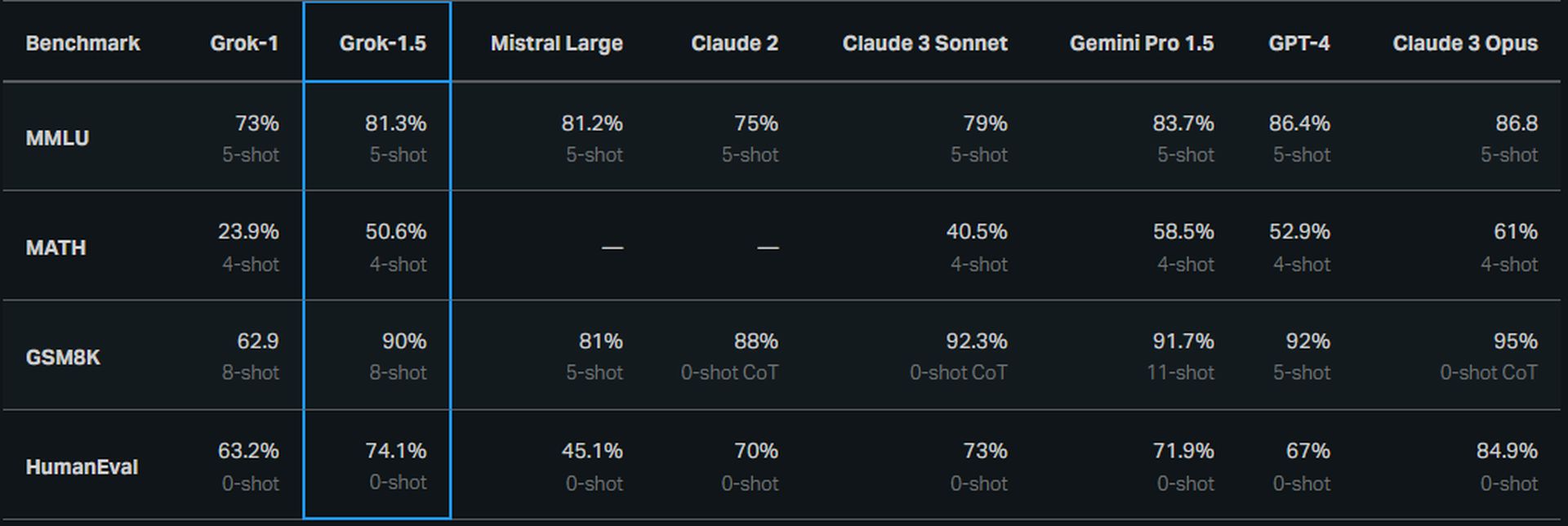

Es scheint, dass xAI speziell auf die Mathematik- und Programmierfähigkeiten von Grok-1.5 abzielt. Laut eigenen Tests von xAI hat sich die Leistung bei Benchmarks, die diese Fähigkeiten messen, deutlich verbessert. Beim MATH-Benchmark (einer Sammlung von Mathematikaufgaben für Grundschule und Wettbewerb) erreichte Grok-1.5 50,6 %. Auch beim GSM8K-Benchmark (einem weiteren mathematischen Aufgabensatz) wurde ein Ergebnis von 90 % erzielt.

Darüber hinaus erreichte Grok-1.5 74,1 % beim HumanEval-Benchmark, der die Fähigkeit der KI misst, Code zu generieren und codierungsbasierte Probleme zu lösen. Dies sind vielversprechende Zahlen, obwohl xAI noch keine detaillierten Fortschritte oder Ergebnisse in anderen Kompetenzbereichen vorweisen kann.

Was kann dies für Benutzer bedeuten?

Auch wenn die technischen Details des Grok-1.5-Upgrades beeindruckend sind, was bedeutet das alles eigentlich für Benutzer? Hier sind einige potenzielle Bereiche, in denen die Verbesserungen Vorteile bringen könnten:

- Dokumentenanalyse: Grok-1.5 könnte besser für die Zusammenfassung langer, komplexer Texte und Berichte geeignet sein. Dies könnte Zeit sparen für diejenigen, die schnell den Inhalt umfangreicher Dokumente erfassen müssen.

- Kreatives Schreiben: Verbessertes Denken und Gedächtnis könnten es Grok-1.5 ermöglichen, kohärentere und strukturiertere Textformate zu generieren, seien es kreative Geschichten, Skripte oder sogar Gedichte.

- Probleme lösen: Die verbesserten Mathematik- und Programmierfähigkeiten der KI könnten bei Aufgaben helfen, die Berechnungen oder die Generierung von Code für bestimmte Zwecke erfordern.

Aber kann es die Giganten entthronen?

Lassen Sie uns analysieren, wie sich der Speicher von Grok-1.5 im Vergleich zu den anderen großen Playern im LLM-Bereich schlägt:

- Grok-1.5: Mit seiner Kurzzeitspeicherkapazität von 128.000 Token verfügt Grok in diesem speziellen Bereich über einen erheblichen Vorteil.

- GPT-4: Während genaue Zahlen nicht öffentlich bestätigt werden, gehen Schätzungen davon aus, dass ChatGPT 4 eine Token-Anzahl von Zehntausenden hat, deutlich weniger als Grok-1.5.

- Google Gemini Advanced: Es wird gemunkelt, dass das KI-Modell von Google eine Tokenzahl von über 100.000 hat. Der Unterschied ist zwar immer noch geringer als bei Grok-1,5, aber geringer als bei ChatGPT 4.

Der erhöhte Speicher von Grok-1.5 bietet zwar einen deutlichen Vorteil, garantiert jedoch nicht, dass er die aktuellen Giganten wie ChatGPT 4 oder Google Gemini Advanced entthronen kann. Erfolg im LLM-Bereich ist ein komplexes Zusammenspiel von Faktoren.

Das Rennen geht weiter

Die Veröffentlichung von Grok-1.5 erfolgt in einer Zeit rasanter Fortschritte im KI-Sektor. Unternehmen und Forschungseinrichtungen stoßen ständig an die Grenzen des Möglichen LLMs tun können.

Es ist eine aufregende Zeit, da der Wettbewerb Innovationen vorantreibt. Wir sollten in den kommenden Monaten und Jahren mit weiteren Verfeinerungen von Grok und der Einführung völlig neuer KI-Modelle rechnen.

Hervorgehobener Bildnachweis: X.ai