Google hat ein innovatives KI-Framework namens „Social Learning“ eingeführt, das die Zusammenarbeitsfähigkeit von Sprachmodellen steigern und gleichzeitig die Privatsphäre der Nutzer schützen soll. Dieses neue Framework ermöglicht es KI-Modellen, sich am Austausch natürlicher Sprache zu beteiligen, Erkenntnisse auszutauschen und ihre kollektiven Fähigkeiten bei verschiedenen Aufgaben zu verbessern, ohne die Privatsphäre zu verletzen.

- Das Konzept inspiriert aus der Theorie des sozialen Lernens von Bandura und Walters aus dem Jahr 1977wobei der Schwerpunkt auf Lernen durch Beobachtung liegt, entweder durch verbale Anweisungen oder durch Nachahmung beobachteter Verhaltensweisen.

- Im Gegensatz zu herkömmlichen kollaborativen Lernmethoden, die möglicherweise einen direkten Datenaustausch beinhalten, ist dieser Ansatz ermöglicht es LLMs, mithilfe natürlicher Sprache voneinander zu lehren und zu lernenum Datenschutzbedenken zu umgehen.

- In dem Papier wird die Anwendung des Frameworks für verschiedene Aufgaben erörtert, darunter Spam-Erkennung, Lösen von Mathematikaufgaben in der Grundschule und textbasierte Beantwortung von Fragenwas seine Vielseitigkeit unter Beweis stellt.

„Große Sprachmodelle (LLMs) haben den Stand der Technik zur Lösung von Aufgaben, die in natürlicher Sprache spezifiziert werden, erheblich verbessert und erreichen oft eine Leistung, die der von Menschen nahe kommt. Da diese Modelle unterstützende Agenten zunehmend in die Lage versetzen, könnte es für sie von Vorteil sein, effektiv voneinander zu lernen, ähnlich wie es Menschen in sozialen Umgebungen tun, was es LLM-basierten Agenten ermöglichen würde, die Leistung der anderen zu verbessern.“

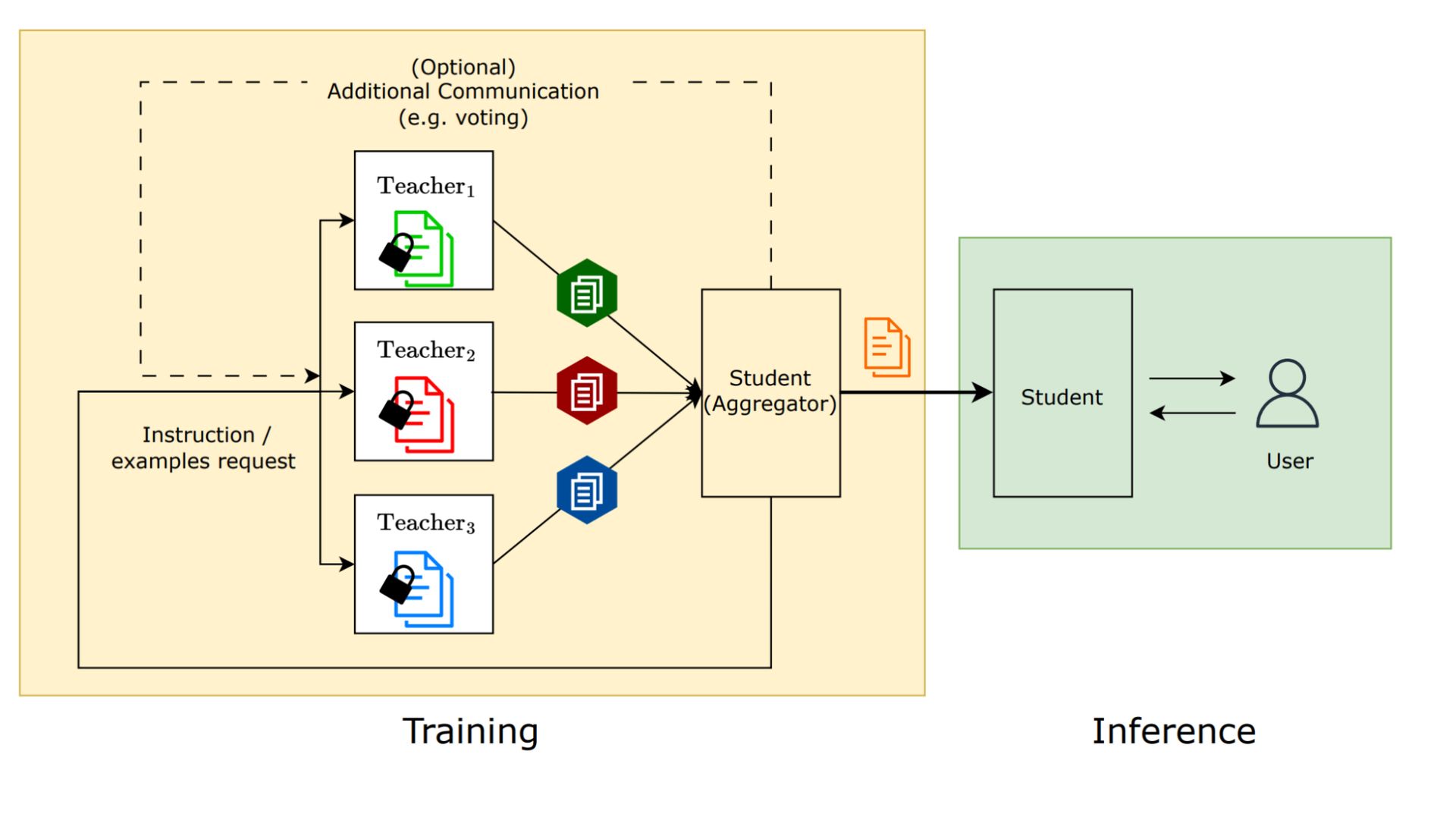

Wie funktioniert das soziale Lernen von Google?

Im Rahmen des Social-Learning-Setups gilt: „Lehrer„Modelle vermitteln Wissen an“Student„Modelle ohne die Notwendigkeit der Übermittlung sensibler oder privater Informationen und schaffen ein Gleichgewicht zwischen effektivem Lernen und Wahrung der Privatsphäre. Diese Schülermodelle ziehen Lehren aus einer Vielzahl von Lehrermodellen, die sich jeweils auf bestimmte Aufgaben wie das Erkennen von Spam, das Lösen mathematischer Rätsel oder das Bereitstellen von Antworten auf der Grundlage von Textinhalten spezialisiert haben.

Durch die Verwendung von Beispielen, die von Menschen überprüft wurden, können Lehrermodelle Schülermodelle unterrichten, ohne die Originaldaten auszutauschen. Damit wird den Datenschutzbedenken im Zusammenhang mit der Datenweitergabe Rechnung getragen. Darüber hinaus haben Lehrermodelle die Möglichkeit, neue Szenarien zu entwerfen oder spezifische Aufgabenanweisungen zu erstellen und so den Bildungsweg zu bereichern.

Forschungsversuche unterstreichen den Erfolg des sozialen Lernens bei der Verbesserung der Kompetenzen von Schülermodellen bei einer Reihe von Aufgaben. Die von Lehrermodellen zusammengestellten synthetischen Szenarien erwiesen sich als ebenso wirkungsvoll wie die authentischen Daten und verringerten gleichzeitig die Gefahren für die Privatsphäre drastisch. Ebenso haben von Lehrermodellen erstellte Aufgabenanweisungen maßgeblich dazu beigetragen, die Leistung von Schülermodellen zu steigern und die Vielseitigkeit der Sprachmodelle bei der Einhaltung von Anweisungen zu demonstrieren.

Um den Datenschutz zu verankern, Die Forschungsgemeinschaft hat Maßnahmen wie die Secret Sharer-Metrik eingeführt, um das Ausmaß der Datenexposition während der Lernphase zu bewerten. Die Ergebnisse zeigen ein vernachlässigbares Eindringen von Datenschutzdaten und bestätigen die Fähigkeit des Frameworks, Anweisungen zu erteilen, ohne Details aus dem ursprünglichen Datenpool preiszugeben.

Diese Modelle ahmen den menschlichen Prozess des sozialen Lernens nach Sie sind geschickt darin, Know-how auszutauschen und ihre Fähigkeiten gemeinsam weiterzuentwickeln, wobei die Privatsphäre der Benutzer stets im Vordergrund steht. Diese Strategie eröffnet neue Wege für die Entwicklung datenschutzbewusster KI-Technologien in verschiedenen Bereichen. Mit Blick auf die Zukunft sind die Forschungsteams bestrebt, das Framework für soziales Lernen weiter zu verfeinern und seinen Nutzen bei verschiedenen Aufgaben und Datenkontexten zu untersuchen.

„Wir haben einen Rahmen für soziales Lernen eingeführt, der es Sprachmodellen mit Zugriff auf private Daten ermöglicht, Wissen durch Textkommunikation zu übertragen und gleichzeitig die Privatsphäre dieser Daten zu wahren. In diesem Rahmen haben wir Sharing-Beispiele und Sharing-Anweisungen als Grundmodelle identifiziert und sie anhand mehrerer Aufgaben bewertet. Darüber hinaus haben wir die Secret Sharer-Metrik an unser Framework angepasst und eine Metrik zur Messung von Datenlecks vorgeschlagen“, erklärte Google in seinem Blogeintrag.

„Als nächsten Schritt suchen wir nach Möglichkeiten, den Lehrprozess zu verbessern, beispielsweise durch das Hinzufügen von Feedbackschleifen und Iteration. Darüber hinaus wollen wir den Einsatz von sozialem Lernen für andere Modalitäten als Text untersuchen“, heißt es im Blogbeitrag weiter.

Hervorgehobener Bildnachweis: Mitchell Luo/Unsplash