Die verstörenden AI-Pornobilder von Taylor Swıft sind überall im Internet zu finden, und viele Leute sind gegen solche Beiträge, darunter Swifties und alle anderen Leute mit einem beträchtlichen Maß an gesundem Menschenverstand. Offensichtlich sind unsere Gesetze immer noch nicht „da“, um gegen die schlechten Akteure hinter diesen Bildern vorzugehen und sie zu bestrafen oder zumindest Konsequenzen zu ziehen. Doch was kann getan werden, um diesen Unsinn zu stoppen und die saftigen Früchte der künstlichen Intelligenz im Rahmen der Ethik zu nutzen?

Taylor Swift KI-Pornos können den Weg zu einer dringend benötigten Veränderung weisen

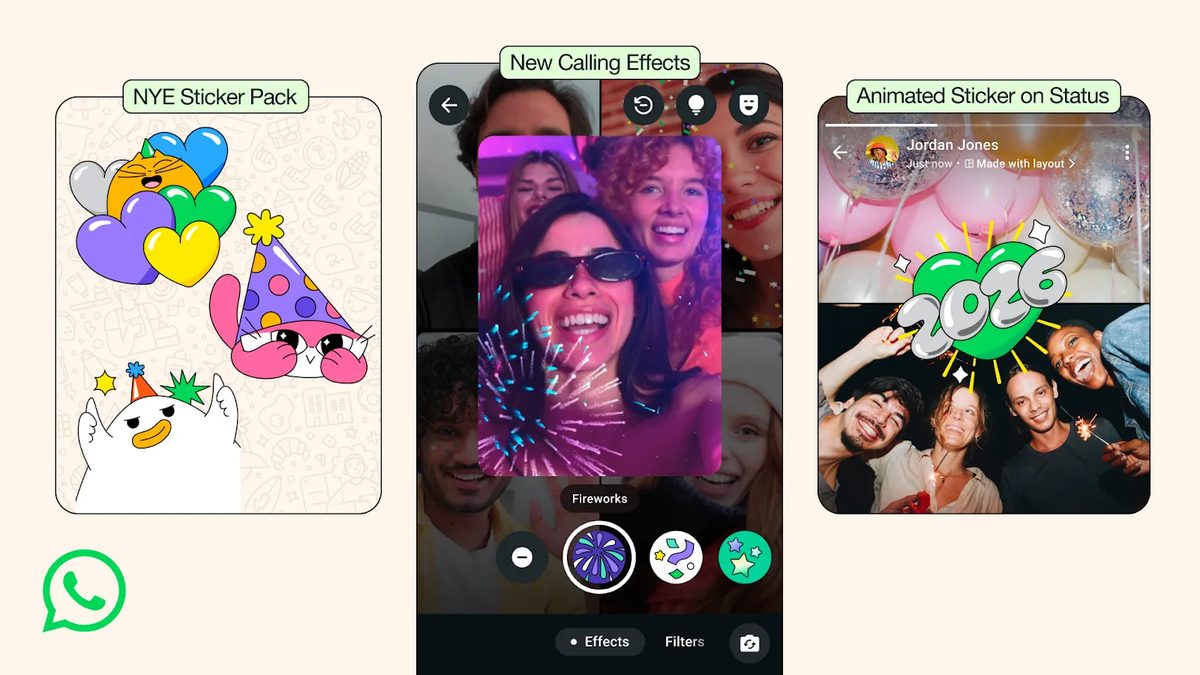

Der AI-Pornovorfall mit Taylor Swift, der die Aufmerksamkeit von US-Politikern und Fans gleichermaßen auf sich gezogen hat, könnte der Auslöser für eine dringend notwendige Überarbeitung der Art und Weise sein, wie wir Deepfake-Technologie regulieren und verstehen.

Der US-Repräsentant Joe Morelle hat die Verbreitung dieser expliziten, gefälschten Fotos von Taylor Swift als „entsetzlich“ bezeichnet. Die Dringlichkeit, dieses Problem anzugehen, hat zugenommen, und die Bilder haben auf Social-Media-Plattformen Millionen von Aufrufen erzielt. Vor seiner Entfernung wurde ein bestimmtes Bild von Swift unglaubliche 47 Millionen Mal angesehen.

Der Vorfall hat zu erheblichen Maßnahmen auf Social-Media-Seiten geführt, wobei einige, wie X, diese Bilder aktiv entfernten und Suchbegriffe im Zusammenhang mit Taylor Swift AI einschränkten. Dieser proaktive Ansatz verdeutlicht jedoch das größere Problem: die allgegenwärtige und unregulierte Verbreitung von Deepfake-Inhalte.

Was ist passiert?

Für diejenigen, die mit dem neuesten KI-Pornoskandal von Taylor Swift nicht vertraut sind, gibt es hier eine kurze Zusammenfassung. Taylor Swift, eine Ikone der Musikindustrie, wurde kürzlich Opfer von KI-Deepfake-Bildern. Diese expliziten Bilder, die sie in beleidigenden Szenarien zeigen, haben nicht nur ihre Fans empört, sondern auch Alarm wegen des Missbrauchs von KI bei der Erstellung solcher Inhalte ausgelöst. Der Vorfall begann am X und löste eine breite Debatte über digitale Ethik und die möglichen Schäden von KI aus.

Swifts Fangemeinde, bekannt als Swifties, hat sich auf digitalen Plattformen versammelt und versucht, die Verbreitung dieser Bilder zu unterdrücken, indem sie das Thema mit nicht verwandten Inhalten überschwemmt. Ihre Aktionen symbolisieren eine kollektive Verteidigung von Swift und einen Widerstand gegen den Missbrauch der KI-Technologie. Taylor Swift ist nicht die einzige Person, die sich mit diesen skandalösen Bildern auseinandersetzen musste, und es sieht so aus, als würde sie nicht die letzte sein, wenn das Bundesgesetz diese Bilder in der Grauzone belässt.

Taylor Swift AI-Bilder enthüllen Sie die dunkle Seite der KI

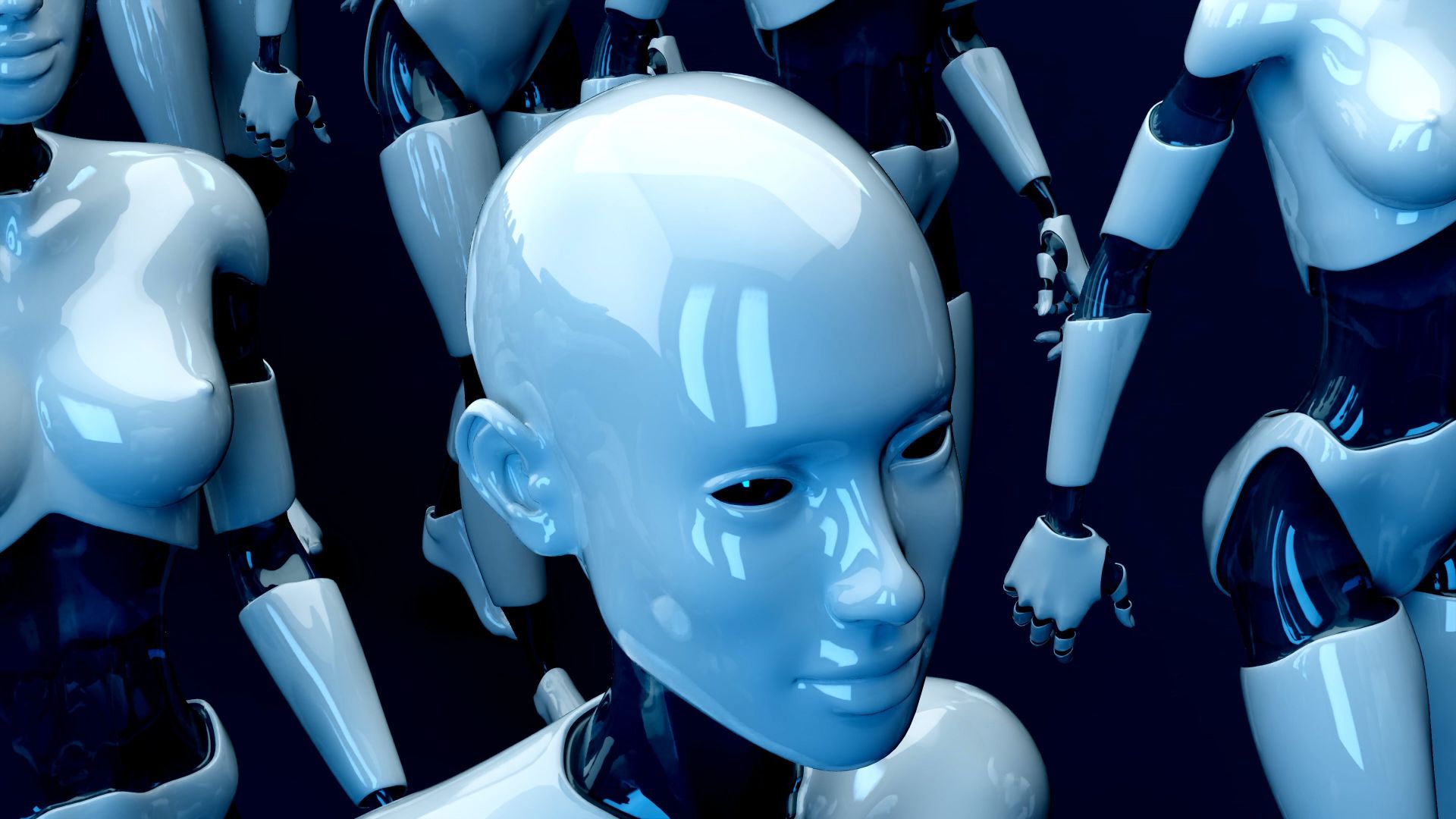

Die Bedrohung der Menschheit durch KI

Der KI-Pornovorfall mit Taylor Swift bringt einen umfassenderen, beunruhigenderen Trend ans Licht: die zunehmende Bedrohung der Menschheit durch KI. Die Deepfake-Technologie, ein Teilbereich der KI, birgt erhebliche Risiken, da sie realistische, aber vollständig erfundene Bilder und Videos erstellen kann. Ursprünglich als Werkzeug für Unterhaltung und harmlose Kreativität betrachtet, hat sich diese Technologie schnell zu einer Waffe zur persönlichen und weitreichenden Ausbeutung entwickelt.

Die Fähigkeit der KI, die Realität zu manipulieren, stellt ein Datenschutzproblem und eine gesellschaftliche Bedrohung dar. Die Leichtigkeit, mit der Deepfakes erstellt und verbreitet werden können, stellt eine Herausforderung für die Vorstellung von Wahrheit und Authentizität im digitalen Raum dar. Es schürt Fehlinformationen und kann möglicherweise zu weit verbreiteter Verwirrung und Misstrauen führen, insbesondere in sensiblen Bereichen wie Politik, Journalismus und öffentlicher Meinung.

Darüber hinaus sind die psychologischen Auswirkungen auf die Opfer von Deepfake-Pornografie, wie in diesem Fall Taylor Swift, tiefgreifend. Diese Opfer erleben Gewalt und Leid, was oft zu einem langfristigen emotionalen Trauma führt. Die Tatsache, dass KI eingesetzt werden kann, um Einzelpersonen auf so persönliche und invasive Weise anzugreifen, verdeutlicht die ethische Krise, die dieser Technologie zugrunde liegt.

Der KI-Pornovorfall mit Taylor Swift ist eine deutliche Erinnerung an das Schadenspotenzial der KI. Es unterstreicht die Notwendigkeit ethischer Richtlinien und Vorschriften zur Regelung der KI-Entwicklung und -Nutzung, um sicherzustellen, dass die Technologie der Menschheit einen positiven Nutzen bringt und nicht zu einem Werkzeug der Ausbeutung und des Schadens wird.

Sind Taylor Swift AI-Pornobilder illegal?

Die Rechtmäßigkeit von KI-Pornobildern von Taylor Swift, wie beispielsweise denen von Taylor Swift, variiert je nach Gerichtsbarkeit erheblich. In den Vereinigten Staaten ist der Rechtsrahmen lückenhaft und auf Bundesebene weitgehend wirkungslos. Nur 10 Staaten haben spezielle Gesetze gegen die Erstellung und Verbreitung von Deepfake-Pornografie. Dieser Mangel an umfassenden Rechtsvorschriften führt dazu, dass Opfer wie Swift in der rechtlichen Schwebe sind und nicht wissen, wie sie gegen solche Verstöße vorgehen sollen.

Die Frage der Rechtmäßigkeit wird durch die Natur des Internets und digitaler Plattformen, in denen die Zuständigkeitsgrenzen verschwimmen, noch komplizierter. Die Ersteller solcher Inhalte bleiben oft anonym und operieren möglicherweise von Standorten mit unterschiedlichen rechtlichen Standards aus, was es schwierig macht, rechtliche Schritte gegen sie einzuleiten.

Im Gegensatz dazu versucht Europa einen strukturierteren Ansatz. Das von der Europäischen Union vorgeschlagene Gesetz über künstliche Intelligenz und die Datenschutz-Grundverordnung (DSGVO) zielen darauf ab, KI-generierte Inhalte wie Deepfakes zu regulieren. Die DSGVO verlangt die Zustimmung zur Verwendung personenbezogener Daten wie Bilder oder Stimmen bei der Erstellung von Inhalten. Diese Vorschriften stoßen jedoch bei der Durchsetzung auf Hürden, insbesondere im Umgang mit anonymen Urhebern und internationalen Grenzen.

Was soll getan werden?

Der KI-Pornovorfall mit Taylor Swift unterstreicht die dringende Notwendigkeit einer Bundesgesetzgebung gegen Deepfake und KI-generierte Bilder in bestimmten Fällen. Umfassende Gesetze sollten umgesetzt werden, um die Erstellung und Verbreitung von Deepfake-Inhalten zu regulieren, insbesondere wenn es sich um nicht einvernehmliche Pornografie handelt.

Über die Gesetzgebung hinaus besteht Bedarf an technologischen Lösungen wie KI-Erkennungstools, um Deepfake-Inhalte zu identifizieren und zu kennzeichnen. Kampagnen zur Sensibilisierung der Öffentlichkeit sind auch von entscheidender Bedeutung, um die Menschen über die Natur von Deepfakes und die Bedeutung der Überprüfung digitaler Inhalte aufzuklären.

Zusammenfassend lässt sich sagen, dass der AI-Pornovorfall mit Taylor Swift ein Weckruf ist. Es beleuchtet die Schattenseiten der KI und die Notwendigkeit robuster rechtlicher und technologischer Rahmenbedingungen, um die Rechte des Einzelnen zu schützen und ethische Standards im digitalen Zeitalter aufrechtzuerhalten.

Hervorgehobener Bildnachweis: Rosa Rafael/Unsplash